Entropia é a magnitude que indica a energia que não pode realizar trabalho útil em um processo termodinâmico. Em geral, o universo tende à desordem. Consequentemente, a entropia, ou seja, o aumento da entropia, portanto, a variação positiva dessa magnitude indica o sentido natural em que qualquer evento ocorre em um sistema isolado.

A entropia (S) é uma magnitude termodinâmica originalmente definida como um critério para prever a evolução de sistemas termodinâmicos. Em qualquer processo irreversível, a desordem do sistema aumenta e, portanto, a entropia aumenta. Se o processo é reversível, a variação de entropia é zero.

A entropia de um sistema é uma função de estado extensiva. O valor dessa magnitude física, em um sistema isolado, cresce durante um processo que ocorre naturalmente. O conceito de entropia descreve o quão irreversível é um sistema termodinâmico.

O que é entropia padrão?

A entropia padrão de uma composição química é sua entropia sob 1 atm de pressão. Esses valores são expressos em uma tabela de entropia que geralmente são indicadas a uma temperatura de 298 K.

Normalmente, nestas tabelas também são expressas as entalpias de formação dos elementos químicos em seus estados padrão zerados. A entalpia de formação é a quantidade de energia necessária para formar essas composições.

Fórmula da entropia na física

Na física, a entropia é a magnitude termodinâmica que permite calcular a parte da energia térmica que não pode ser usada para produzir trabalho se o processo for reversível. A entropia física, em sua forma clássica, é definida pela equação proposta por Rudolf Clausius:

![]()

ou mais simplesmente, se a temperatura for mantida constante no processo 1 → 2 (processo isotérmico):

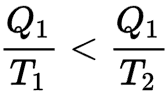

Assim, se um corpo quente na temperatura T1 perde uma quantidade de calor Q1, sua entropia diminui em Q1/T1, se ele transfere esse calor para um corpo frio na temperatura T2 (menor que T1) a entropia do corpo frio aumenta mais que a entropia do corpo quente diminuiu porque

Um motor reversível pode, portanto, transformar parte dessa energia térmica em trabalho.

Desempenho de um motor térmico reversível

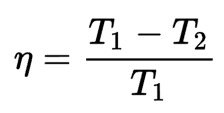

O desempenho da máquina reversível indica a relação máxima de energia útil que pode ser convertida em trabalho. Essa relação pode ser expressa pela seguinte fórmula:

Para que toda a energia térmica pudesse ser transformada em trabalho, seria necessário que o ponto quente estivesse a uma temperatura infinita ou o ponto frio estivesse a zero kelvin; caso contrário, a eficiência termodinâmica do motor reversível é menor que 1.

A expressão da entropia é uma consequência lógica da segunda lei da termodinâmica e da forma como a temperatura é medida. A segunda lei da termodinâmica diz que, se nenhum trabalho for consumido, o calor flui dos corpos quentes para os corpos frios.

Por que não é possível conhecer a entropia absoluta?

No mundo real não é possível determinar a entropia absoluta porque seria necessário atingir a temperatura de zero kelvin.

Na física, sempre trabalhamos com variações de entropia, pois para saber o valor absoluto, primeiro seria necessário conseguir chegar ao 0 absoluto. Para chegar ao 0 absoluto, o sistema precisaria esfriar a zero kelvin para que as moléculas não se movessem mais. A partir daqui, aumentar a temperatura aumentaria a entropia.

No entanto, do ponto de vista físico, não é possível atingir a temperatura de zero kelvin, de acordo com o teorema de Walther Nernst apresentado na terceira lei da termodinâmica.